IA – ses risques et effets secondaires

Le Conseil d’éthique conseille le Gouvernement allemand – et avertit contre un enthousiasme non soumis à la critique vis-à-vis de l’utilisation de l’intelligence artificielle.

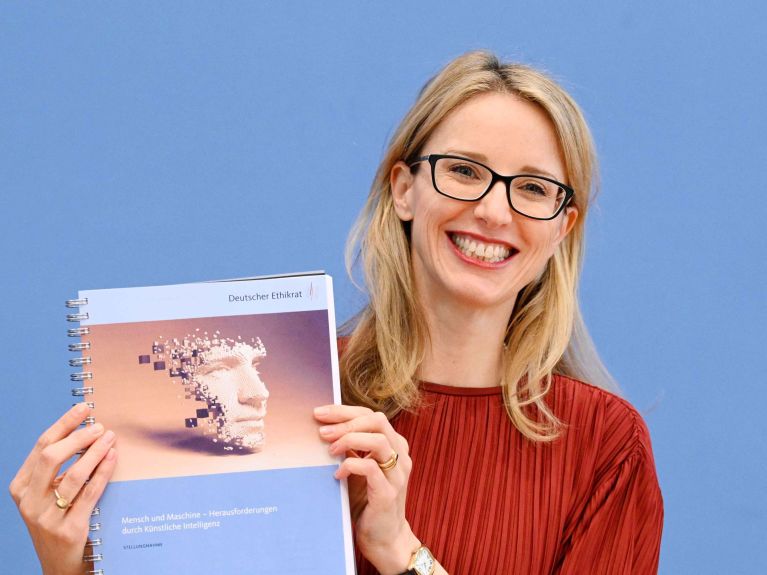

L’intelligence artificielle est omniprésente. « Elle peut être utilisée pour diagnostiquer des cancers ou apprendre du vocabulaire anglais avec des écolières et écoliers, mais aussi pour déterminer qui doit percevoir certaines prestations sociales et pour influencer notre comportement sur les réseaux sociaux », explique la professeure Alena Buyx, Présidente du Conseil d’éthique allemand. Simplifier les processus, soulager les personnes, détecter des maladies, voilà qui promet un beau nouveau monde. Le Conseil d’éthique, chargé en 2020 par le Bundesrat d’étudier les opportunités et risques de l’IA, ne voit toutefois pas l’avenir tout rose. « L’IA ne doit pas remplacer l’humain », affirme la Présidente de la commission composée de scientifiques de différentes spécialités qui conseille les organes politiques et le Gouvernement pour les questions d’éthique. A. Buyx formule le résultat principal comme suit : « L’utilisation de l’IA doit permettre l’expansion de l’épanouissement, la capacité de création et les possibilités d’action des personnes et non les diminuer. »

L’IA ne doit pas remplacer l’humain.

Sur 287 pages, le Conseil d’éthique a décrit dans la tribune « Humain et machine » quels risques et quelles opportunités la commission associe aux nouvelles technologies. Le rapport (en allemand) a été présenté mi-mars à Berlin. L’une des missions importantes du Conseil d’éthique est d’étudier les nouveaux développements d’un œil critique et d’avertir des dangers associés. C’est ce qu’il fait dans son expertise. Judith Simon, professeure d’éthique dans la technologie de l’information à l’Université de Hambourg déclare que l’objectif d’un transfert de tâches à l’IA doit servir principalement l’expansion des capacités humaines. La mission serait donc d’« éviter une diminution de la capacité humaine d’action et de création ainsi qu’une diffusion de la responsabilité. »

La responsabilité ne peut pas être déléguée aux machines.

Le professeur Julian Nida-Rümelin, ancien ministre de la Culture en Allemagne, souligne également l’importance de la responsabilité humaine. Elle ne peut pas « être déléguée à des machines ou partagée avec des machines ». C’est surtout concernant l’utilisation de l’intelligence artificielle dans les médias et la communication comme dans les moteurs de recherche, les offres d’actualité ou les réseaux sociaux que le Conseil d’éthique soupçonne des risques importants en cas d’utilisation non transparente de l’IA. Les offres personnalisées surtout pourraient donner l’impression d’un choix objectif, mais ne reflètent dans les faits que le comportement d’utilisation antérieur compilé par l’IA. Le motif serait l’intérêt commercial de fournisseurs privés de fidéliser leurs utilisateurs. « Un rétrécissement de l’éventail d’informations et d’avis proposé, telle est la conséquence », avertit J. Nida-Rümelin. Selon l’avis du Conseil d’éthique, une structure de communication numérique de droit public pourrait être une possibilité de contrer cela – en guise d’alternative aux plateformes d’entreprises numériques privées. Il ne doit pas y avoir d’amalgame avec la radio de droit public en Allemagne, ces plateformes pourraient par exemple être exploitées par des fondations de droit public sans grande influence de l’État, explique J. Nida-Rümelin.

Tu souhaites recevoir régulièrement des informations sur l’Allemagne ? Voici où t’inscrire :