人工智能——它的风险及副作用

伦理委员会对德国政府提出建议,并就不加限制地使用人工智能发出警告。

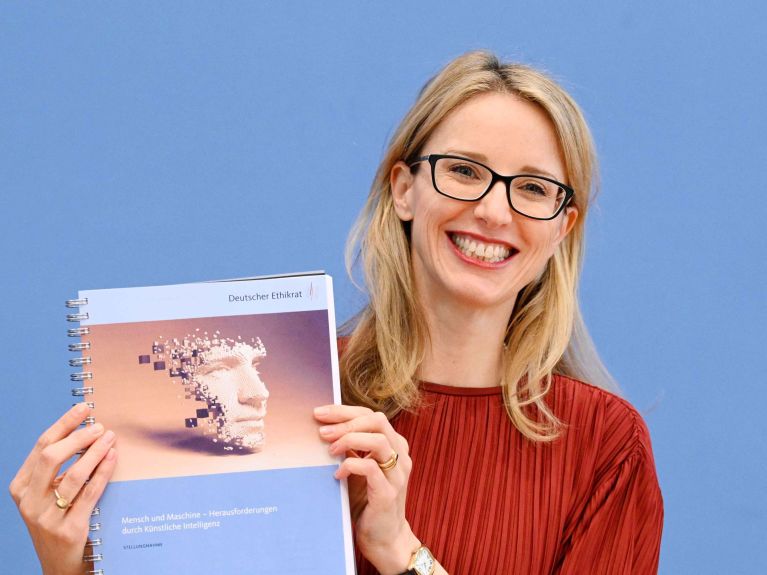

人工智能无处不在。“它可以被用于诊断癌症或与学生一起学习英语词汇,也可以用来确定谁应该获得某些社会福利,并影响我们在社交媒体上的行为。”阿莱娜·布伊克斯 (Alena Buyx)这样说,她是德国伦理委员会主席。简化流程,减轻人们识别疾病的负担,这听起来像是一个美丽新世界。然而,受联邦议院委托于 2020 年开始研究“人工智能机会和危险”的伦理委员会认为,未来并不全是美好的。“人工智能不能取代人类。”智囊团主席这样说,这个智囊团由各学科科学家组成,并就伦理问题向政治家和政府提供建议。布伊克斯这样陈述核心结果:“人工智能的使用必须推动人类发展、扩展人类的作者身份并增加行为的可能性,而不是削弱和减少。”

人工智能不能替代人类。

伦理委员会在 287 页的报告上写下有关“人类和机器”的观点,小组认为存在哪些危险和机会与新技术相关。三月中旬,这份报告(以德语形式)在柏林进行发表和讲解。伦理委员会的重要任务是,以批判的眼光看待新发展,并对危险提出警告。这就是委员会在编制《专家意见》时所做的。朱迪思·西蒙 (Judith Simon),汉堡大学信息技术伦理学教授说道,原则上,将任务转移给人工智能的目标应当是有助于拓展人类的能力。因此,任务是“防止削弱人类的行为能力和减少人类的作者身份,并防止责任的分散”。

不能将责任分配给机器。

前德国文化部部长朱利安·尼达-诺姆林教授强调人类责任的意义。不能将责任“分配给机器或与机器分担责任”。伦理委员会认为,在媒体和通讯中使用人工智能,如搜索引擎、新闻推送或社交媒体,如果不能实现透明使用人工智能,那将存在巨大风险。特别是个性推送会给人造成是客观选择的印象,但实际上这是人工智能处理过用户行为后的反映。究其原因是私人供应商需要将用户与企业捆绑并从中获得商业利益。“所提供的信息和意见的范围被缩小,这就是结果。”朱利安·尼达-诺姆林警告说。伦理委员会认为,应对这种情况的方法之一可以是建立一个公共数字通信结构——用于替代私人数字企业的平台。尼达-诺姆林说,这不应与德国的公共广播混为一谈,这些平台可以由公共基金会运营,不受到过多的国家影响。

您希望定期接收到有关德国的信息?在此注册: