ИИ — риски и побочные эффекты

Совет по этике консультирует немецкое правительство и предостерегает об опасности слепого восторга по поводу использования искусственного интеллекта.

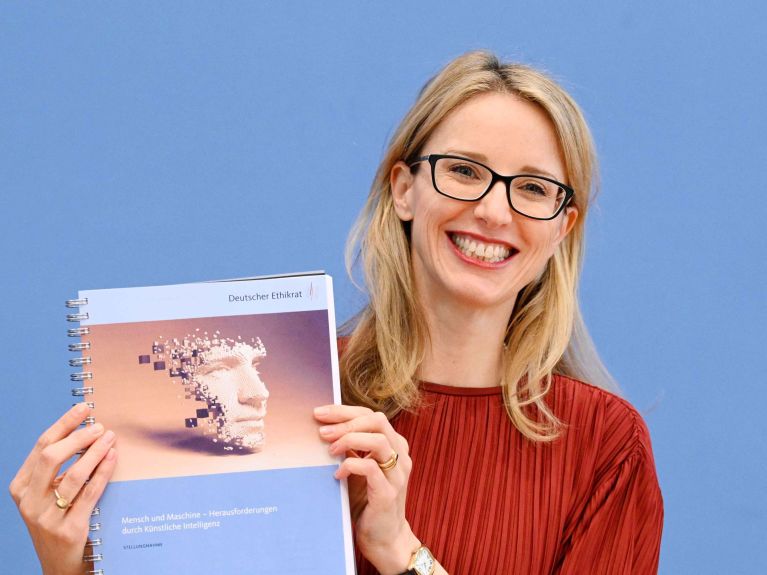

Искусственный интеллект вездесущ. «Его можно использовать для диагностики рака или для изучения лексики на уроках английского языка, а также для того, чтобы определить, кто должен получать определенные социальные пособия, и чтобы влиять на наше поведение в соцсетях», — говорит профессор Алена Бюкс, председатель Немецкого совета по этике. Упрощение процессов, помощь людям в распознавании болезней — звучит как сказка. Однако Совет по этике, которому бундестаг в 2020 году поручил изучить возможности и опасности, связанные с развитием ИИ, видит будущее не только в розовом цвете. «ИИ не должен заменить людей», — считает председатель комитета, состоящего из ученых разных специальностей, который консультирует политиков и правительство по этическим вопросам. Основной результат госпожа Бюкс формулирует следующим образом: «ИИ должен расширять человеческие возможности, авторство и свободу действий, а не уменьшать их».

ИИ не должен заменить людей.

В своем 287-страничном отчете «Человек и машина» Совет по этике назвал опасности и возможности, которые комитет связывает с развитием новых технологий. Отчет (на немецком языке) был представлен в Берлине в середине марта. Важная задача Совета по этике заключается в критическом рассмотрении новых разработок и предупреждении о возможных опасностях. Именно это он и делает в своем заключении. Джудит Саймон, профессор этики в сфере информационных технологий Гамбургского университета, говорит, что, по сути, цель передачи задач искусственному интеллекту заключается в расширении возможностей человека. Поэтому задача состоит в том, чтобы «предотвратить сокращение доли человеческого участия и авторства, а также рассеивание ответственности».

Ответственность не может делегироваться машинам.

Профессор Юлиан Нида-Рюмелин, бывший госминистр Германии по вопросам культуры, также подчеркивает важность ответственности человека. Ее нельзя «делегировать машинам или разделять с машинами». Совет по этике видит большую опасность как раз при использовании искусственного интеллекта в средствах массовой информации и коммуникации, таких как поисковые машины, новостные ленты и соцсети, если не сделать это использование прозрачным. Персонализированные предложения могут создавать впечатление объективного выбора, но на самом деле они являются результатом воспроизведения предыдущего поведения пользователя, проанализированного ИИ. Причина заключается в желании частных провайдеров привязать к себе своих пользователей с целью заработка. «Как следствие, спектр предлагаемой информации и мнений сужается», — предостерегает Нида-Рюмелин. Одним из способов противодействия, по мнению Совета по этике, могла бы стать публично-правовая цифровая коммуникативная структура, выступающая в качестве альтернативы платформам частных цифровых концернов. Ее не следует путать с общественным телерадиовещанием в Германии — эти платформы могли бы работать под управлением публично-правовых фондов без особого влияния государства, считает Нида-Рюмелин.

Хотите регулярно получать информацию о Германии? Зарегистрируйтесь здесь: