AI – zagrożenia i skutki uboczne

Rada Etyki doradza niemieckiemu rządowi – i ostrzega przed bezkrytycznym entuzjazmem w stosowaniu sztucznej inteligencji.

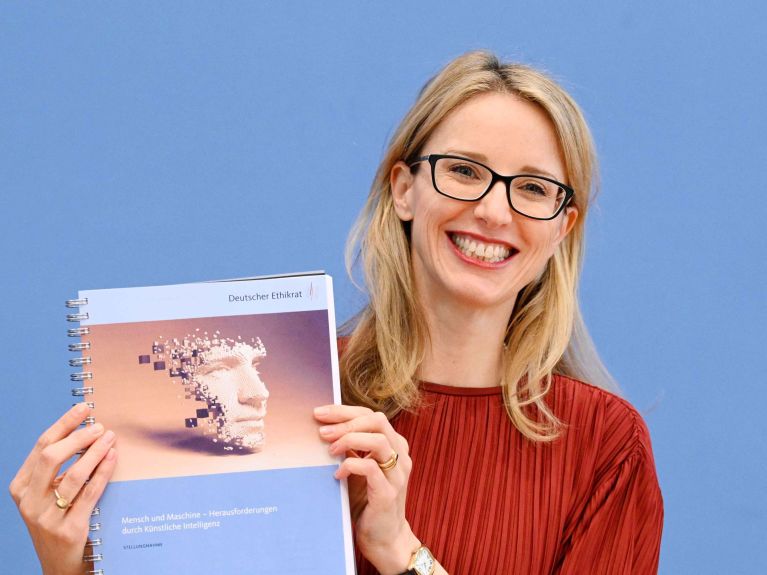

Sztuczna inteligencja jest już obecna w każdej dziedzinie życia. „Może pomóc diagnozować raka lub uczyć uczniów angielskiego słownictwa, lecz także decydować o tym, komu zostaną przyznane określone świadczenia socjalne czy wpływać na nasze zachowania w mediach społecznościowych“, mówi profesor Alena Buyx, przewodnicząca Niemieckiej Rady Etyki. Uproszczenie procesów, odciążenie ludzi, rozpoznawanie chorób – brzmi jak nowy, lepszy świat. Rada Etyki, której Bundesrat w 2020 roku zlecił zbadanie szans i zagrożeń związanych ze sztuczną inteligencją (AI), nie widzi jednak przyszłości jedynie w jasnych barwach. „AI nie może zastąpić człowieka“, mówi przewodnicząca gremium złożonego z naukowców różnych specjalności, doradzającego politykom i rządowi w kwestiach etyki. Buyx podsumowała wnioski następująco: „Zastosowanie sztucznej inteligencji musi poszerzać rozwój człowieka, jego sprawczość i zdolność do działania, nie może ich ograniczać“.

AI nie może zastąpić człowieka.

Na 287 stronach swojego raportu „Człowiek i maszyna”, Rada Etyki wymienia zagrożenia i szanse, jakie zdaniem gremium niesie z sobą zastosowanie nowych technologii. Raport (w języku niemieckim) został zaprezentowany w połowie marca w Berlinie. Istotnym zadaniem Rady Etyki jest krytyczna ocena nowych wynalazków i wskazywanie związanych z nimi zagrożeń. Wnioski z rozważań zostały przez nią zawarte w wydanej opinii. Judith Simon, profesor etyki w technologii informatycznej na Uniwersytecie w Hamburgu podkreśla, że celem powierzenia pewnych zadań sztucznej inteligencji powinno być zasadniczo poszerzanie ludzkich umiejętności. Należy zatem „zapobiegać ograniczaniu ludzkiej sprawczości i zdolności do działania, a także rozproszeniu odpowiedzialności“.

Nie można przenosić odpowiedzialności na maszyny.

Także profesor Julian Nida-Rümelin, były minister kultury w Niemczech, podkreśla znaczenie ludzkiej odpowiedzialności. „Nie można przenosić odpowiedzialności na maszyny ani współdzielić jej z maszynami“. Rada Etyki zwraca uwagę na poważne zagrożenia związane z wykorzystaniem sztucznej inteligencji w mediach i komunikacji, na przykład w wyszukiwarkach, wiadomościach lub mediach społecznościowych, zwłaszcza gdy AI nie jest stosowana w sposób dostatecznie transparentny. Spersonalizowana oferta może sprawiać wrażenie obiektywnego wyboru, jednak w rzeczywistości odzwierciedla przygotowane przez AI, przewidziane zachowania użytkownika. Ma to związek z komercyjnym interesem prywatnych usługodawców, którzy chcą przywiązać do siebie użytkowników. „Skutkuje to zawężeniem spektrum dostępnych informacji i opinii“, ostrzega Nida-Rümelin. Jednym ze sposobów, by temu przeciwdziałać, mogłaby być zdaniem Rady Etyki publiczna struktura komunikacji cyfrowej – alternatywa dla platform prywatnych koncernów informatycznych. Nie należy jej mylić z mediami publicznymi w Niemczech, ponieważ te platformy mogłyby być obsługiwane na przykład przez fundacje prawa publicznego bez większej ingerencji państwa, mówi Nida-Rümelin.

Chcesz regularnie otrzymywać informacje o Niemczech? Zarejestruj się tutaj: