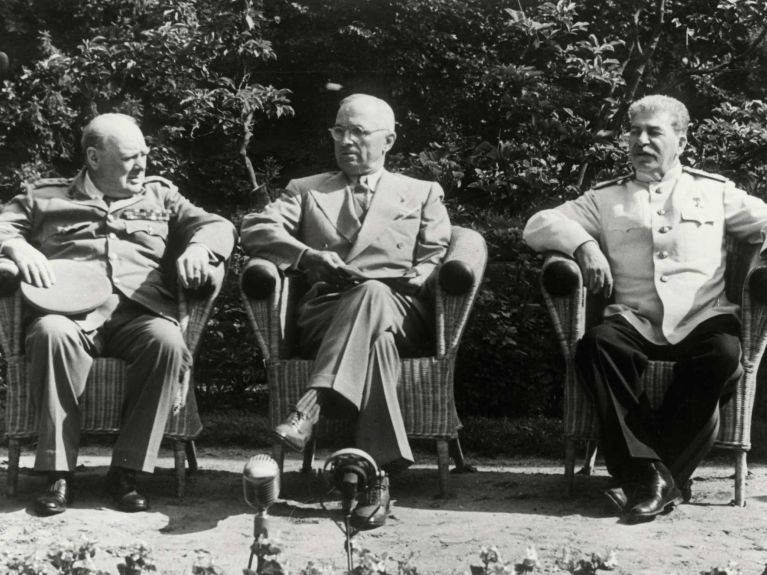

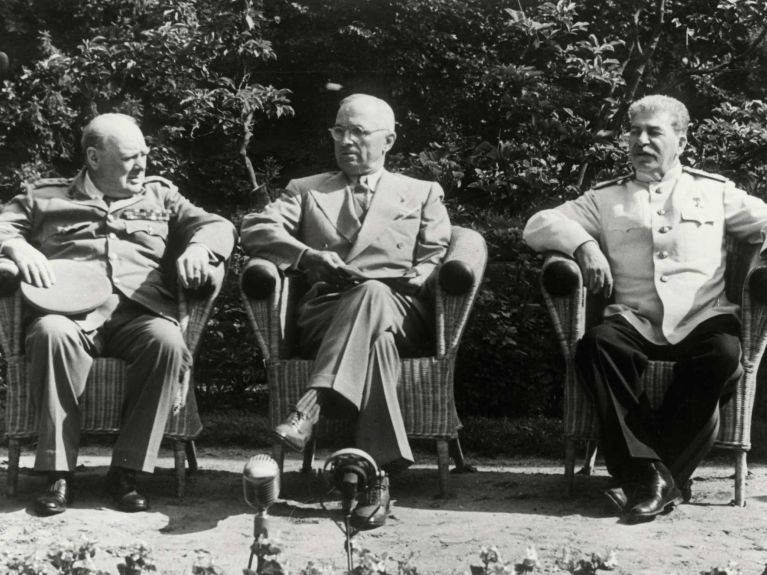

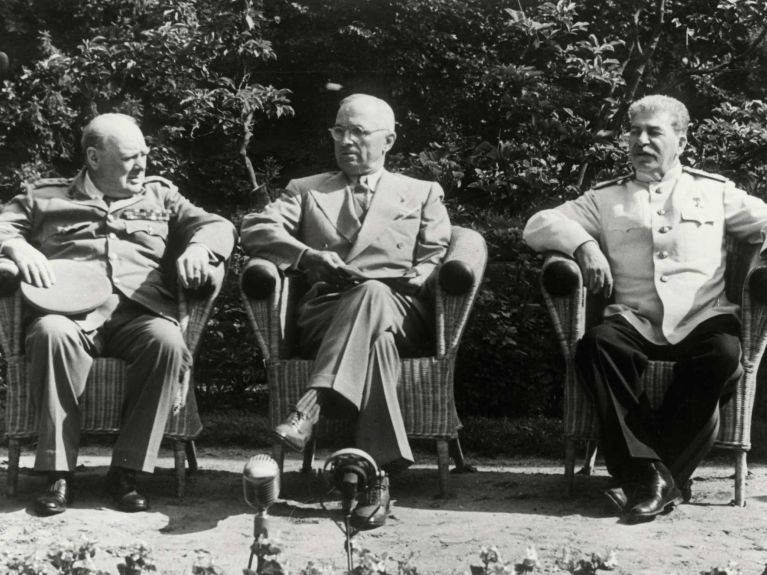

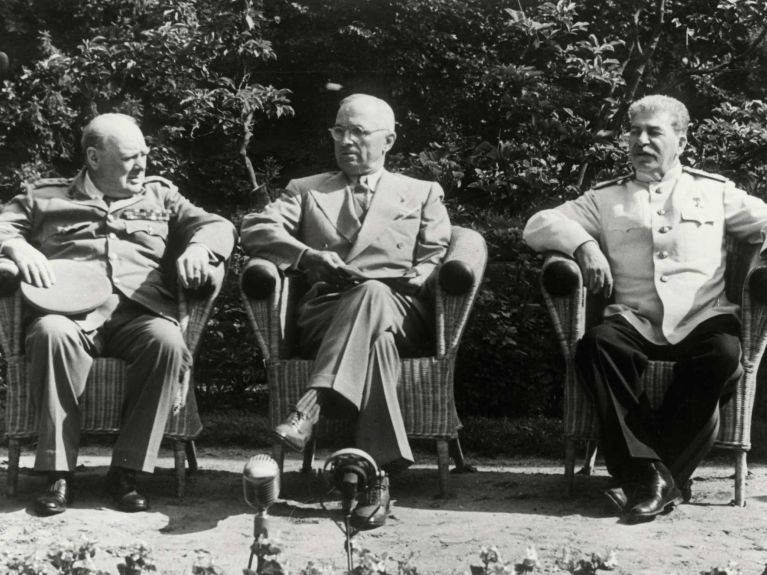

Faces and Moments: Nachkriegszeit

Nach dem Zweiten Weltkrieg übernahmen die USA eine entscheidende Rolle beim Wiederaufbau Deutschlands.

28.09.2018

Nach dem Zweiten Weltkrieg übernahmen die USA eine entscheidende Rolle beim Wiederaufbau Deutschlands.